OpenAI anuncia novo modelo que promete revolucionar a inteligência artificial

Modelo o3 foi anunciado pela OpenAI em uma live na sexta-feira, dia 20, e modelo é considerado o mais avançado até hoje.

Os modelos de linguagem de grande escala, ou large language models (LLMs) ganharam muito destaque nos últimos anos. Uma das aplicações mais conhecidas é o ChatGPT da empresa OpenAI que alcançou milhões de usuários em pouco tempo. LLMs são treinados para entender e gerar texto, além de possuírem um leque de aplicações que vão desde análise de textos até geração de textos ou imagens.

Recentemente, empresas como OpenAI, Google e Facebook estão juntando LLMs com modelos de reasoning (reasoning models). Os reasoning models conseguem realizar deduções lógicas e resolver problemas complexos ao conectar informações. Recentemente, juntar a linguagem natural e o raciocínio lógico é objetivo de várias empresas que já estão propondo seus modelos.

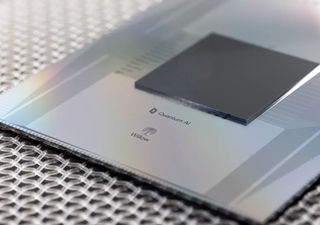

Na sexta-feira, dia 20, a OpenAI anunciou através de uma live o lançamento do modelo o3 que está sendo chamado de modelo de IA mais avançado do mundo. Ele combina uma compreensão superior de matemática e em programação além de conversas. Sua arquitetura integra LLM com aprendizado por reforço de forma a integrar processamento linguístico e raciocínio lógico.

LLM

Os LLMs são, em maioria, baseados em uma arquitetura conhecida como Transformer que foi proposta pela Google em 2017. Os LLMs são treinados em enormes quantidades de dados de texto fazendo com que os modelos consigam compreender e gerar textos. Outras aplicações semelhantes são feitas em imagens e em vídeos abrindo ainda mais as possíveis aplicações de modelos generativos.

Para melhorar a capacidade das LLMs, diversos grupos de pesquisas focam em juntar reasoning models com LLMs. Dessa forma é esperado que LLMs melhorem sua precisão e capacidade de generalização. Além disso, os modelos estão sendo usados para responder perguntas específicas em empresas e na Ciência ao utilizar bancos de dados próprios ao realizar um fine-tuning em modelos já existentes.

Aprendendo a raciocinar

A ideia por trás de um modelos de raciocínio, ou reasoning models, é imitar o processo de raciocínio humano ao resolver problemas com dedução e indução. Com isso, esse modelos são usados para resolver problemas matemáticos, conduzir análises científicas e contribuir em situações que há muitas variáveis. Por causa das diversas aplicações possíveis, vários grupos estão focando em melhorar as técnicas.

Os reasoning models utilizam técnicas que conseguem estruturar o raciocínio como, por exemplo, o chain-of-thought prompting que os modelos tem que mostrar passos intermediários. Outra técnica é o self-consistency decoding que analisa diferentes linhas de raciocínio para selecionar a melhor. Outros modelos estruturam cadeias de lógica hierárquicas. Além disso, o uso dessas técnicas com redes neurais permite combinar o aprendizado de padrões com raciocínio lógico.

Modelo o3

Nessa sexta-feira, a OpenAI, empresa famosa pelo ChatGPT, anunciou o seu novo modelo de inteligência artificial chamado de modelo o3. Este modelo combina LLMs com habilidades de raciocínio. O que mais chamou atenção é a capacidade do o3 em resolver problemas de matemática avançada e raciocínio lógico. Para isso, o o3 foi treinado com técnicas chain-of-thought prompting.

O chain-of-thought prompting divide problemas em etapas menores e explica os passos intermediários criando uma linha de raciocínio. Além disso, o3 apresentou melhor compreensão de código e geração de algoritmos do que seu antecessor o1. A OpenAI também anunciou que o o3 conseguiu resultados nunca vistos antes em testes feitos para quantificar quão perto estamos de uma inteligência geral artificial, ou AGI.

Chegamos na AGI?

Desde que os resultados do modelo o3 foram anunciados e de ter conseguido realizar testes importantes para a AGI, como ARC-AGI. É improtante notar que esses testes não significam que alcançamos a AGI. O ARC é projetado para avaliar habilidades específicas, como raciocínio abstrato, mas não conceitos como criatividade e compreensão emocional.

Os resultados do o3 é um progresso na área mas ele ainda depende de dados pré-treinados e de regras que controlam o aprendizado. Embora o o3 represente um passo importante rumo à AGI, é muito cedo para afirmar que já chegamos ou estamos prestes a chegar nela.